Apa itu Teks Langsung? Bagaimana Cara Menggunakannya di iOS 15 dan iPadOS 15?

Miscellanea / / August 04, 2021

Dengan pembaruan iOS 15, Apple memperkenalkan fitur baru yang disebut Teks langsung. Fitur ini memungkinkan Anda menggunakan teks atau nomor apa pun yang dapat Anda temukan dengan jendela bidik iPhone dan memanfaatkannya secara bermakna. Fitur teks langsung baru di iOS 15 membantu dalam tugas sehari-hari, dan sangat membantu saat Anda bepergian ke suatu tempat dan tidak tahu bahasa mereka. Pada artikel ini, kami akan menjelaskan segala sesuatu tentang teks langsung di iOS 15.

Teks langsung adalah fitur berguna yang memungkinkan Anda mengambil teks atau angka dari jendela bidik kamera atau dari foto yang telah diambil. Anda dapat menggunakan fitur ini untuk melakukan banyak hal. Ini memungkinkan Anda melakukan hal-hal seperti menyalin teks, mencari produk atau memanggil nomor langsung dari Viewfinder itu sendiri. Teknologi ini mirip dengan Google Lens, yang dapat digunakan untuk mendapatkan hasil yang sama. Namun, fitur ini sekarang tersedia untuk perangkat iOS dan dapat digunakan di perangkat iPhone dan iPad yang memiliki pembaruan iOS 15 terbaru.

Isi Halaman

-

Apa itu Teks Langsung Cara Menggunakannya di iOS 15 dan iPadOS 15

- Kasus penggunaan dunia nyata

- Cara menggunakan Fitur Teks Langsung di iOS atau iPadOS 15

- Kesimpulan

Apa itu Teks Langsung Cara Menggunakannya di iOS 15 dan iPadOS 15

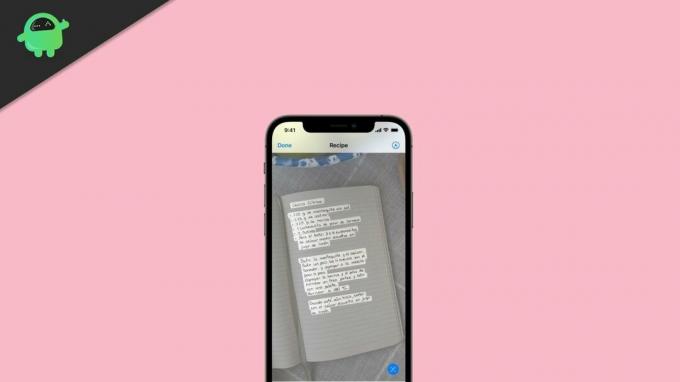

Untuk memulainya, fitur Livetext dapat mengolah gambar menjadi teks. Fitur ini tidak berhenti di situ, dan juga diperluas ke Pengenalan Karakter Optik. Fitur ini dapat membantu Anda memproses teks dari tulisan tangan, misalnya dari buku catatan.

Jadi, jika Anda telah menulis catatan pada sebuah seminar, dan Anda ingin mengirimkannya sebagai dokumen kata, Anda tidak perlu mengetik ulang semuanya; OCR memungkinkan Anda memindai teks dan mengubahnya menjadi teks digital yang dapat Anda gunakan pada Dokumen Digital. Livetext juga dapat melakukan lebih dari itu. Ini sangat kontekstual sadar. Oleh karena itu juga dapat digunakan untuk memindai kode QR.

Kasus penggunaan dunia nyata

Nah, fitur-fitur ini mungkin menggoda Anda untuk berpikir, seperti apa skenario kasus penggunaan dunia nyata untuk fitur ini. Sebenarnya, ada banyak hal untuk dikatakan, tetapi saya akan menjelaskan beberapa yang dapat membantu Anda memahami kasus penggunaan fitur ini di dunia nyata.

Misalnya, Anda dapat mengarahkan kamera ke buku bank dan menyalin nomor rekening sehingga Anda tidak perlu memeriksa ulang berkali-kali untuk memastikan bahwa itu adalah nomor rekening yang benar. Atau Anda cukup menunjukkan kartu kunjungan dan memindai alamat email atau nomor telepon dari kartu tersebut.

Kemudian Anda dapat dengan mudah menghubungi nomor tersebut atau mengirim email karena fitur ini dapat membawa Anda ke aplikasi yang sesuai langsung dari jendela bidik.

Iklan

Cara menggunakan Fitur Teks Langsung di iOS atau iPadOS 15

Sebenarnya, iOS 15 saat ini hanya ada di tangan pengembang untuk pengujian beta. Jadi beta publik akan keluar bulan depan bagi Anda untuk mendapatkan langsung dan menguji fitur ini. Jadi, setelah Anda mendapatkan akses ke versi beta iOS 15, Anda seharusnya dapat menemukan fitur ini sebagai aplikasi terpisah atau terintegrasi ke dalam jendela bidik. Either way, itu akan melakukan pekerjaan yang sama.

Pada titik ini, Anda seharusnya sudah tahu bahwa Anda hanya dapat melihat fitur ini di iOS 15 atau iPad OS 15. Tapi itu hanya sisi perangkat lunak. Untuk perangkat keras, Anda mungkin memerlukan setidaknya chipset Apple A12 Bionic. Ini berarti Anda harus memiliki setidaknya iPhone X atau lebih tinggi atau iPad mini generasi ke-5 ke atas. Alasannya adalah bahwa teks Langsung ini menggunakan Mesin Neural Apple yang terdapat pada chip bionik A12. Jadi tidak mungkin menjalankan aplikasi di iPhone atau iPad generasi lama seperti iPhone 7, 8 atau iPad mini.

Kesimpulan

Jadi seperti yang Anda lihat, fitur teks langsung di iOS atau iPad OS 15 akan menjadi masalah besar saat dirilis ke publik. Tidak seperti Google Lens, yang menggunakan Google cloud untuk menghitung semuanya, Livetext akan berjalan secara lokal di Neural Engine. Ini bisa bermanfaat dalam beberapa hal. Karena ketika menggunakan cloud untuk melakukan operasi, kami bergantung pada koneksi internet yang berfungsi, cepat, dan andal. Oleh karena itu ketika komputasi dijalankan secara lokal, Anda dapat menghindari kebutuhan akan internet yang cepat. Namun, tidak tepat untuk langsung mengambil kesimpulan sekarang. Karena hasil dapat bervariasi ketika kami memiliki produk yang sebenarnya untuk diuji.

Iklan